Een AI-model dat alleen een uitslag geeft, zoals “hoog risico” of “afwijkend”, is in veel situaties niet genoeg. Je wilt ook weten waarom het model tot die conclusie komt. Dit is essentieel in sectoren waar beslissingen grote gevolgen hebben, zoals de medische diagnostiek, financiële compliance of kwaliteitscontrole. Onderzoekers van MIT en de Polytechnische Universiteit van Milaan hebben een nieuwe methode ontwikkeld die AI-modellen dwingt om hun voorspellingen te verklaren met behulp van voor mensen begrijpelijke concepten.

Wat is een concept bottleneck model?

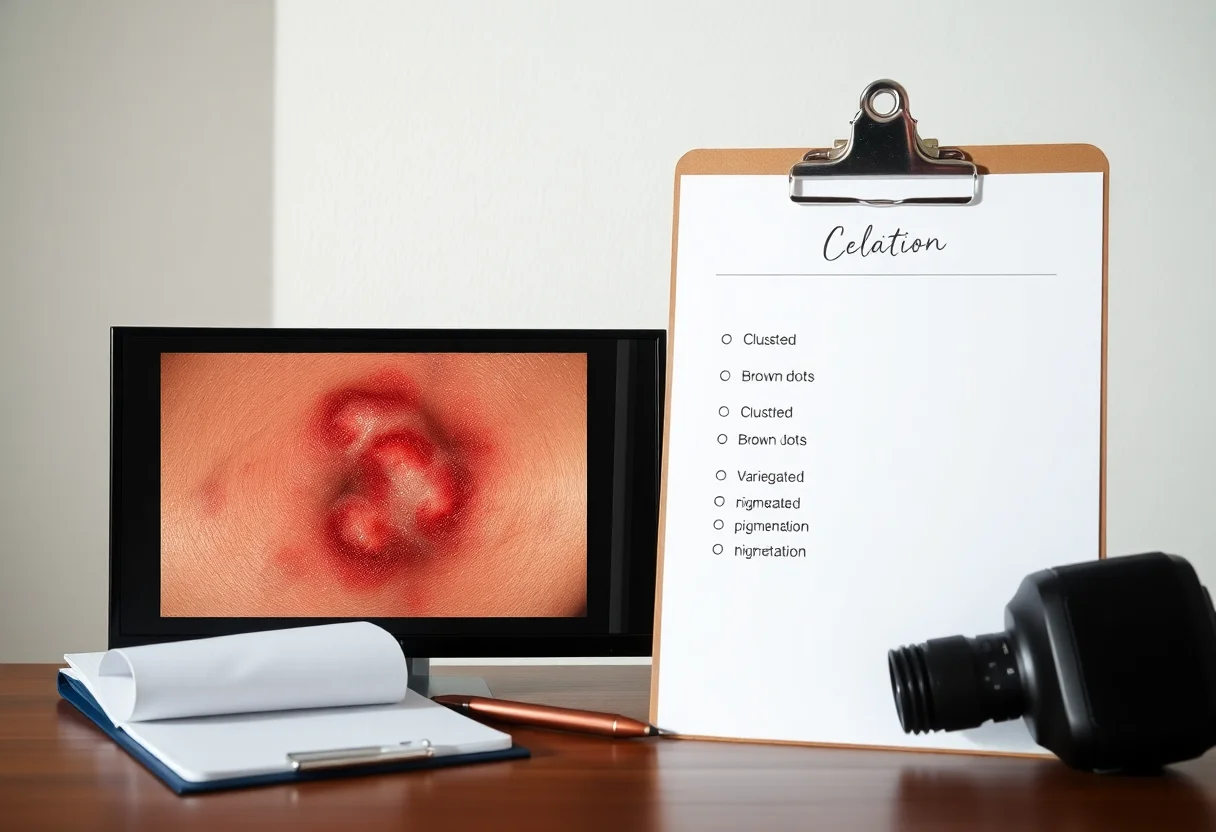

De traditionele aanpak, ‘concept bottleneck modeling’, werkt door een AI-model te forceren om via vooraf door experts gedefinieerde concepten te redeneren. Een voorbeeld: om huidkanker te herkennen, moet het model eerst concepten als “geclusterde bruine vlekken” of “ongelijke pigmentatie” identificeren, voordat het een diagnose stelt. Dit maakt de redenering transparant. Het probleem is dat deze vooraf bedachte concepten soms niet precies genoeg zijn of niet aansluiten bij wat het model daadwerkelijk heeft geleerd, wat de nauwkeurigheid kan verminderen.

De nieuwe aanpak: concepten uit het model zelf halen

De nieuwe methode pakt dit probleem aan door de concepten niet vooraf op te leggen, maar ze juist uit het getrainde AI-model zelf te extraheren. Het gebruikt een paar gespecialiseerde modellen die de kennis van het oorspronkelijke model “uitlezen” en vertalen naar duidelijke, tekstuele concepten. Hierdoor sluiten de gebruikte verklaringen beter aan bij de werkelijke denkwijze van het model. Volgens de onderzoekers kan hun techniek elk voorgetraind computervisiemodel omzetten in een model dat concepten gebruikt om zijn redenering uit te leggen.

Waarom dit belangrijk is voor ondernemers en professionals

Voor een ondernemer of professional gaat dit verder dan technische nieuwsgierigheid. Het gaat om aansprakelijkheid en vertrouwen. Als je een AI-systeem inzet voor het screenen van sollicitanten, het beoordelen van kredietrisico’s of het analyseren van medische scans, is een zwarte doos die alleen een score geeft een groot risico. Je kunt de uitkomst niet controleren, niet uitleggen aan een klant of toezichthouder, en moeilijk ingrijpen bij een fout. Een model dat zijn werkwijze kan uitleggen met herkenbare concepten, verhoogt de transparantie en maakt het mogelijk om het besluit te valideren.

Hoe kun je dit vandaag toepassen?

Deze onderzoeksmethode zelf is nog niet direct beschikbaar als kant-en-klare tool. De kernles voor ondernemers is echter duidelijk: bij het selecteren van AI-oplossingen moet je niet alleen kijken naar nauwkeurigheid, maar ook naar uitlegbaarheid. Vraag leveranciers expliciet naar hoe hun modellen tot conclusies komen.

Als je een zorginstelling runt of medische software gebruikt… kun je bij de aanschaf of ontwikkeling van diagnostische AI-tools specifiek vragen naar ’explainable AI’ (XAI) of ‘concept bottleneck’ functionaliteiten. Een optie is om te eisen dat de software niet alleen een diagnose suggereert, maar ook visueel of tekstueel aangeeft op welke kenmerken in de scan of het labresultaat die suggestie is gebaseerd, zoals “verhoogde waarde X in combinatie met patroon Y”.

Als je werkt in compliance, finance of risicomanagement… is het cruciaal dat AI-systemen voor fraudedetectie of risicoscoring hun bevindingen kunnen onderbouwen. Je zou kunnen overwegen om alleen tools te implementeren die een audit trail bieden, waarin staat: “klant gemarkeerd vanwege ongebruikelijke transactiepatronen in regio Z gedurende periode A.” Dit maakt handhaving en communicatie met toezichthouders eenvoudiger.

Als je een productiebedrijf hebt met kwaliteitscontrole via AI… dan wil je niet alleen weten dát een product afgekeurd is, maar ook waarom. Een mogelijke stap is om te zoeken naar visie-inspectiesystemen die naast een “fail” ook een uitsplitsing geven, zoals “afwijking gedetecteerd: kras van >2mm op locatie B, kleurafwijking buiten tolerantie.” Dit helpt bij het oplossen van het onderliggende productieprobleem.

Als je een dienst verleent waarbij AI advies geeft aan klanten… bijvoorbeeld in juridische scan, financiële planning of recruitment, dan bouw je meer vertrouwen op als je het advies kunt ondersteunen. Overweeg om tools te kiezen die, in plaats van alleen een kandidaatsscore, ook de redenen tonen: “sterke match vanwege ervaring met projectmanagement in sector X en certificering Y.” Dit maakt je dienstverlening transparanter en waardevoller.

De ontwikkeling benadrukt een grotere trend: de toekomst van AI in professionele omgevingen ligt niet in ondoorgrondelijke zwarte dozen, maar in samenwerkende systemen die hun werkwijze kunnen communiceren. Door nu al prioriteit te geven aan uitlegbaarheid bij je AI-keuzes, beperk je toekomstige risico’s en win je het vertrouwen van klanten, partners en toezichthouders.

Bron: MIT News